Los investigadores, los responsables políticos y la industria deberían implicar a los niños y a sus cuidadores a la hora de diseñar nuevas políticas e iniciativas relacionadas con las tecnologías basadas en la inteligencia artificial (IA). Esta es la principal recomendación de un informe del JRC publicado recientemente sobre la inteligencia artificial y los derechos del niño.

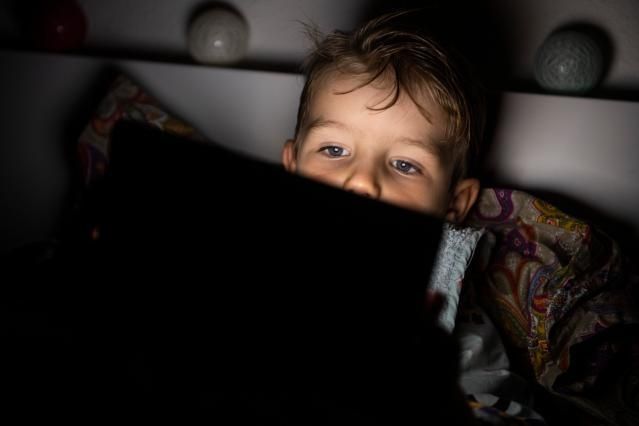

Las tecnologías digitales y de Internet basadas en la inteligencia artificial ofrecen muchas oportunidades a los niños, pero, si no se diseñan y utilizan adecuadamente, también pueden afectar negativamente a algunos de sus derechos, como el derecho a la protección, la participación, la educación y la privacidad.

Los padres, los profesores y los niños rara vez participan directamente en la elaboración de políticas o en la investigación que pretende mitigar los riesgos y aumentar los beneficios de la IA. Pero al diseñar las políticas, cuantas más partes interesadas interactúen, más podremos garantizar que se tengan en cuenta las perspectivas de todas las partes.

El informe del CCI sobre la IA y los derechos del niño trata de arrojar luz sobre este aspecto.

Además, también identifica los requisitos clave por los que debería regirse la IA, los métodos para permitir un compromiso más eficaz entre las principales partes interesadas y las lagunas de conocimiento que deben abordarse para garantizar el respeto de los derechos fundamentales de los niños cuando interactúan con la tecnología de la IA en su vida cotidiana.

El informe del CCI incluye reflexiones de expertos invitados en la materia que participaron y contribuyeron al estudio. También contribuye a la investigación científica para la elaboración de políticas que se lleva a cabo en el CCI en el ámbito de la IA de confianza para los niños.

Sus resultados se utilizarán para apoyar la aplicación de varias estrategias de la UE, como la estrategia de la UE sobre los derechos del niñoBuscar traducciones disponibles en el enlace anteriorES y la estrategia de la UE para una mejor Internet para los niñosBuscar traducciones disponibles en el enlace anteriorES (BIK+), y la propuesta de ley de la UE sobre la IABuscar traducciones disponibles en el enlace anteriorES.

¿Qué hace que la IA sea digna de confianza?

Según el informe del CCI, el desarrollo de herramientas fiables basadas en la IA y utilizadas por los niños requiere:

- Tomar decisiones estratégicas y sistémicas durante el desarrollo de servicios y productos basados en la IA destinados a los niños para garantizar su sostenibilidad, ya que estas herramientas utilizan muchos recursos naturales y energéticos.

- Permitir que los niños y sus cuidadores tengan el control sobre el uso de sus datos personales por parte de la tecnología de IA.

- Explicar los sistemas de IA en un lenguaje adaptado a los niños y de forma transparente, y responsabilizar a los actores de la IA del buen funcionamiento de los sistemas que desarrollan, operan o despliegan.

- La ausencia de sesgos discriminatorios en los datos o algoritmos en los que se basan.

Métodos para un compromiso eficaz

El informe también propone a los investigadores y a los responsables políticos algunos métodos tangibles para facilitar la participación tanto de los niños como de las partes interesadas en la aplicación de las recomendaciones mencionadas.

Deben aplicarse enfoques participativos de múltiples partes interesadas, con la participación de los niños, los investigadores, los responsables políticos, la industria, los padres y los profesores para definir los objetivos comunes y construir una IA adaptada a los niños desde el diseño.

Estos enfoques serán más eficaces si se basan en la comunicación y la colaboración, y si abordan las prioridades conflictivas entre las partes. La inclusión de las poblaciones infrarrepresentadas mitigaría la discriminación y promovería la equidad entre los niños que crecen en contextos culturales diversos.

Asimismo, la creación de marcos y conjuntos de herramientas, que incorporen aspectos como la protección de datos personales y la evaluación de riesgos, ayudaría a orientar el diseño y la evaluación de sistemas de IA adaptados a los niños a corto y largo plazo.

Abuso sexual de menores: la Comisión propone nuevas estrategias de protección y empoderamiento de los niños en línea

|

Lagunas de conocimiento que deben abordarse

Dado que las pruebas científicas sobre el impacto de la IA en los niños son limitadas, los autores del CCI han identificado algunas lagunas de conocimiento que deben abordarse en las agendas de investigación y política.

Por ejemplo, sería necesario investigar más sobre el impacto del uso de la tecnología de IA en las capacidades cognitivas y socioemocionales de los niños; las escuelas deberían preparar a los niños para un mundo transformado por la tecnología de IA y, por tanto, desarrollar sus competencias y su alfabetización; y los sistemas basados en la IA dirigidos a los niños deberían desarrollarse para adaptarse a su etapa cognitiva.

Una mezcla de enfoques de investigación

Para sacar estas conclusiones, los investigadores del CCI utilizaron una combinación de enfoques.

Seleccionaron tres aplicaciones de IA para niños y las examinaron desde el punto de vista del derecho de los niños, donde también se identificaron ciertos riesgos, como la falta de respeto a la privacidad de los niños, la posible discriminación algorítmica y la falta de equidad.

Organizaron dos talleres con niños y jóvenes, y tres talleres con responsables políticos e investigadores en el ámbito de la IA y los derechos del niño, que revelaron que cada grupo daba prioridad a diferentes preocupaciones.

Además, se revisaron las iniciativas políticas actuales en materia de IA y derechos del niño de ocho importantes organizaciones internacionales. Se comprobó que coincidían, hasta cierto punto, en cuanto a los riesgos y oportunidades identificados en materia de IA para los niños, aunque diferían en cuanto a objetivos y prioridades.

Deja una respuesta